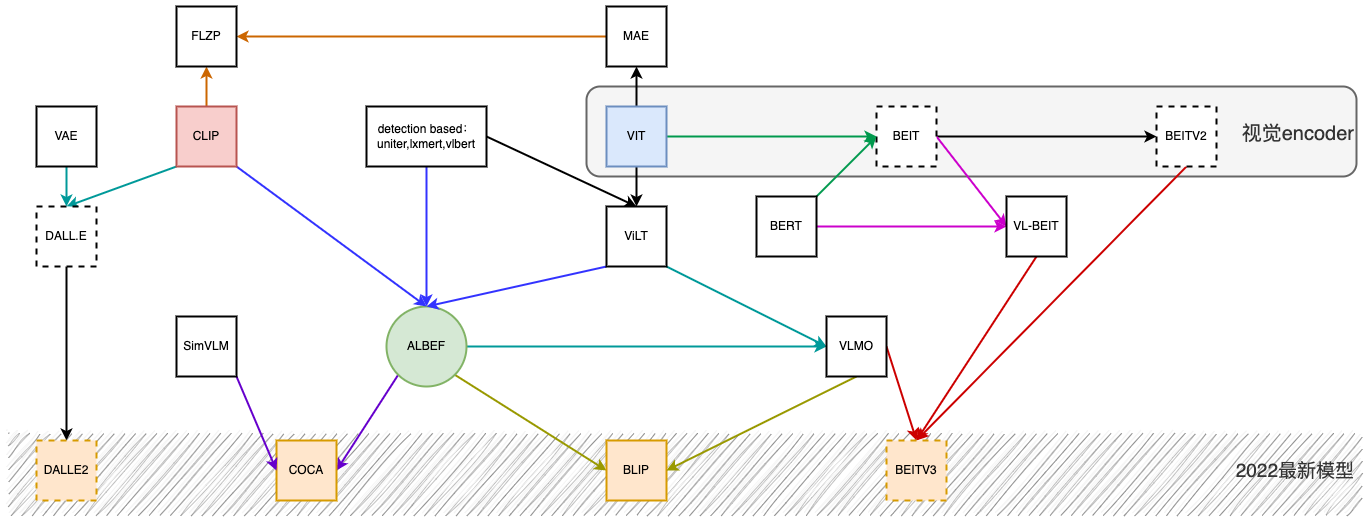

2022年多模态领域的一篇很棒的工作,由ALBEF原班人马打造,结合了ALBEF和VLMO的共同优点,提出了统一结构的多阶段多模态模型,此外提出了一套可行的基于caption-filter的数据筛选self-training策略,值得一读。

论文链接:https://arxiv.org/abs/2201.12086

主要参考b站:多模态论文串讲·下【论文精读·49】

BLIP的贡献值主要有两个

- 模型层面,提出了encoder-decder的多模态结构,弥补了encoder-based的结构,例如CLIP这种做不了生成任务,Fusion-encoder模型结构例如ALBEF、VLMo没办法直接用来做retrieval的问题;

- 数据层面,提出了基于image-caption和image-text-filter策略的数据过滤方法,该操作显著提升了模型的性能,这种方式可以当做一个通用的数据筛选策略。